Yapay Zeka Verimliliği Tam Olarak Nedir?

Yazılım dünyasında yapay zeka (AI) verimliliği, genellikle "daha hızlı kod yazmak" olarak basitleştirilir. Ancak gerçek verimlilik, sadece metin üretmek değil; bir problem setini AI'ın bilişsel kapasitesine uygun şekilde parçalara ayırıp yönetebilmektir. Biz buna İnsan-Ajan Orkestrasyonu diyoruz. Burada yapay zeka bir daktilo değil, talimatlarınızı icraya döken bir Teknoloji Ortağı rolündedir.

Gerçek verimlilik, AI'a bir soru sorup cevap beklemek değildir. Gerçek verimlilik; mimari kararları, iş mantığını ve teknik kısıtları AI'ın anlayabileceği bir Semantik Mimari üzerinden aktarmaktır. Bu süreç doğru yönetilmediğinde, AI sadece hız kazandırır; ancak bu hız, yanlış yöne giden bir trenin hızı gibidir.

AI Bir "Sihirli Değnek" mi?

Pek çok ekip, yapay zekayı projenin içine aktardıklarında karmaşıklığın otomatik olarak çözüleceğini bekliyor. Ancak bu beklenti, AI'ın teknik potansiyelini kısıtlayan en yaygın metodolojik yaklaşımlardan biridir. "Prompt Engineering" disiplini genellikle sadece süslü cümleler kurmak olarak algılanıyor; oysa bu süreç, aslında Yazılım Mimarisi ve mantıksal katmanlama bilgisinin AI arayüzüne taşınmasıdır.

Bu bakış açısı, ekipleri 'AI üretsin biz sonra düzeltiriz' yaklaşımına ve beraberinde gelen hız illüzyonu riskine itebiliyor. Sonuç? Hızla büyüyen ancak denetlenmesi güç bir Teknik Borç yapısı. AI'ı bir otomasyon aracı olarak değil, bir "karar verici" gibi konumlandırdığınızda, projenin kontrolü teknik disiplinden uzaklaşarak yönetilmesi zor hatalara dönüşebilir.

Yüksek Performanslı Ekipler AI'ı Nasıl Yönetiyor?

Verimli ekipler, AI çıktılarının kalitesini tesadüfe bırakmazlar. Aşağıdaki stratejik yaklaşımlar, sadece kod yazımını değil, bir projenin tüm yaşam döngüsünü Ölçeklenebilirlik ve sürdürülebilirlik ilkeleriyle yönetmenizi sağlar. Ayrıca, sadece kod üretimine değil, kod review süreçlerinin dönüşümüne de odaklanırlar.

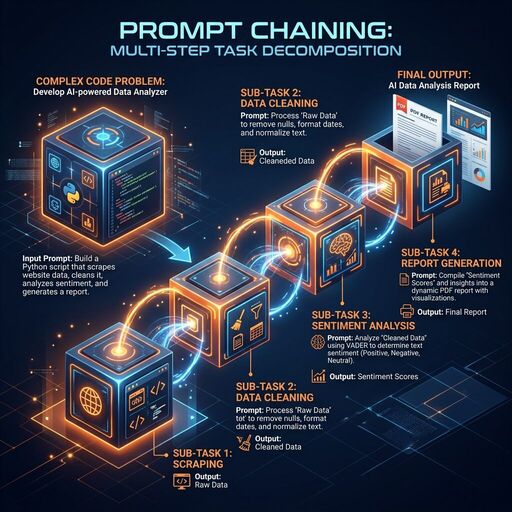

1. Adım Adım İlerleme (Prompt Chaining)

AI'a tek bir prompt içinde her şeyi yaptırmaya çalışmak, genellikle karmaşık ve hatalı sonuçlar doğurur. Karmaşık görevleri parçalara bölün.

Neden Hayat Kurtarır?

Büyük bir problemi tek seferde çözmeye çalışan AI, genellikle mantıksal boşluklar bırakır veya kodun yarısında bağlamı kaybeder. Prompt Chaining (Zincirleme) yöntemiyla, her adımda AI'ın çıktısını doğrular ve bir sonraki adımın temeli haline getirirsiniz. Bu, özellikle karmaşık Kurumsal Otomasyon projelerinde hata payını minimize eder.

Kurumsal Uygulama Senaryosu (Python Data Pipeline)

Diyelim ki bir SLA (Hizmet Seviyesi Anlaşması) denetim scripti hazırlayacaksınız. Script; legacy bir SQL veritabanından logları çekmeli, gecikme sürelerini analiz etmeli ve kritik eşiği geçenleri bir rapor olarak sunmalıdır.

❌ Yanlış Yaklaşım (Tek Seferde):

"SQL'den logları oku, gecikmeleri bul, 5 saniyeyi geçenleri raporla ve mail atacak Python kodunu yaz."

✅ Doğru Yaklaşım (Zincirleme):

- Adım (Mimari Bağlam): "Önce SQL veritabanına bağlanacak, bağlantı hatalarını (retry logic) yönetecek modüler bir

DatabaseHandlersınıfı yazalım." - Adım (Veri İşleme): "Şimdi bu handler'den gelen ham veriyi

pandaskullanarak temizleyen ve 'latency_ms' sütununu hesaplayan bir processing katmanı ekleyelim." - Adım (Denetim & Raporlama): "Son olarak, hesaplanan gecikmelerde 5000ms eşiğini geçenleri filtreleyip, sonuçları JSON-formatında raporlayan fonksiyonu kurgulayalım. Bu yaklaşım, AI'ın projede bir karar kilidi oluşturmasını engeller."

Gelişmiş Kod Örneği:

import pandas as pd

import logging

class SLAChecker:

def __init__(self, raw_data):

self.df = pd.DataFrame(raw_data)

def process_logs(self):

# Adım 2: Veri işleme katmanında kesinlik

try:

self.df['timestamp'] = pd.to_datetime(self.df['timestamp'])

self.df['latency_ms'] = (pd.to_datetime(self.df['end_time']) - self.df['timestamp']).dt.total_seconds() * 1000

return self.df

except Exception as e:

logging.error(f"Veri işleme hatası: {e}")

return None

def detect_violations(self, threshold_ms=5000):

# Adım 3: İş mantığı ayrıştırması

processed_df = self.process_logs()

if processed_df is not None:

violations = processed_df[processed_df['latency_ms'] > threshold_ms]

return violations.to_dict(orient='records')

return []

# Bu zincirle üretilen kod, modülerdir ve her aşaması (DB, Analiz, Rapor) ayrı ayrı test edilebilir.

2. Uzman Kimliği Atama (Persona Use)

AI'a bir rol verdiğinizde, o rolün terminolojisine, önceliklerine ve teknik standartlarına uygun cevaplar üretir.

Neden Hayat Kurtarır?

AI'ın varsayılan tonu genellikle genelleyici ve yüzeyseldir. Ona bir Senior Cloud Architect kimliği atadığınızda, sadece kod yazmakla kalmaz; o kodun Ölçeklenebilirlik, güvenlik ve Cloud-Native prensiplerine uygunluğunu da denetler. Bu, özellikle karmaşık sistem mimarilerinde kritik hataların önüne geçer.

Kurumsal Uygulama Senaryosu (Architectural Review)

Diyelim ki bir veritabanı bağlantı havuzu (connection pool) yönetimi yazdıracaksınız.

❌ Yanlış Yaklaşım (Genel):

"Bana Python'da veritabanı bağlantılarını yöneten bir script yaz."

✅ Doğru Yaklaşım (Persona):

"Sen 20 yıllık deneyime sahip, yüksek trafikli sistemler üzerinde uzmanlaşmış bir Senior Backend Architect'sin. Aşağıdaki Python kodunu Performans Optimizasyonu ve kaynak sızıntılarını önleme açısından incele. Özellikle Singleton pattern kullanımı ve bağlantı temizleme (cleanup) mekanizmalarına odaklan."3. Örneklerle Yönlendirme (Few-Shot Prompting)

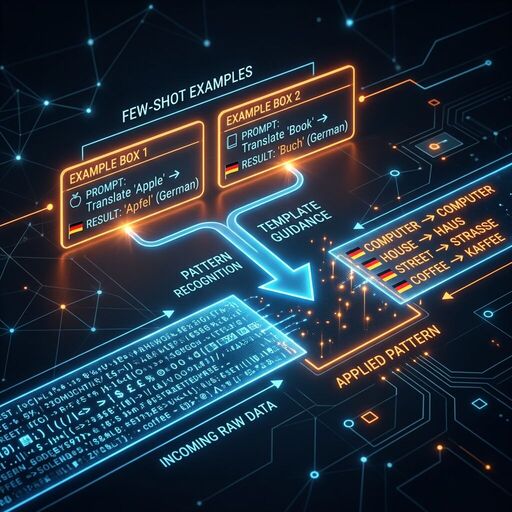

AI'ın nasıl bir çıktı deseni (pattern) üretmesini istediğinizi 1-2 somut örnekle göstermek, doğruluğu dramatik şekilde artırır.

Neden Hayat Kurtarır?

Sektöre özgü jargonlar veya kurumsal veri standartları her zaman AI'ın eğitim verisinde bulunmayabilir. Few-Shot Prompting ile AI'a bir "öğrenme örneği" verirsiniz; AI bu deseni klonlayarak binlerce satır veriyi sıfır hatayla işleyebilir.

Kurumsal Uygulama Senaryosu (Veri Standardizasyonu)

Farklı legacy sistemlerden gelen düzensiz kullanıcı verilerini kurumsal bir Pydantic modeline dönüştürmeniz gerektiğini hayal edin.

✅ Doğru Yaklaşım (Örnekli):

"Aşağıdaki ham verileri şu Python veri modeline dönüştür. İşte iki örnek: Girdi: 'USR-99 | A. Yılmaz | 0532...' -> Çıktı:User(id=99, name='Ahmet Yılmaz', phone='532...')Girdi: 'ID:102 - Canan Su - (212)...' -> Çıktı:User(id=102, name='Canan Su', phone='212...')Şimdi bu veriyi işle: 'User_44 / M. Kara / +90505...'"

Gelişmiş Kod Örneği (Pydantic ile):

from pydantic import BaseModel, field_validator

import re

class User(BaseModel):

id: int

name: str

phone: str

@field_validator('phone')

@classmethod

def clean_phone(cls, v):

# AI'dan bu regex logic'ini Few-Shot ile doğru kurgulamasını isteyebilirsiniz

return re.sub(r'D', '', v)

# AI bu modeli Few-Shot örnekleriniz sayesinde legacy verilerle otomatik besleyebilir.4. Mantık Zinciri Kurma (Chain of Thought)

AI'dan sonucu vermeden önce "adım adım düşünmesini" isteyerek mantık hatalarını kendi kendine fark etmesini sağlayabilirsiniz.

Neden Hayat Kurtarır?

Modern LLM'ler (Large Language Models), bir sonraki kelimeyi tahmin ederek ilerler. Eğer karmaşık bir Yazılım Mimarisi problemini çözmeden direkt kodu yazmaya başlarsa, yolun yarısında mantıksal bir tıkanıklık yaşayabilir. Ona "önce mantığı kur" derseniz, AI önce bir Pseudocode veya akış şeması oluşturur; bu da nihai kodun hatasız olmasını sağlar.

Kurumsal Uygulama Senaryosu (Mimari Analiz)

Diyelim ki bir kullanıcının kaydı sırasında hem yerel veritabanına kayıt yapan hem de harici bir CRM sistemine API isteği gönderen bir işlem (transaction) kurgulayacaksınız.

✅ Doğru Yaklaşım (Plan İsteği):

"Aşağıdaki çok adımlı kayıt sürecini Python'da kurgulayacağız. Önce bu sürecin hata durumlarını (rollback mekanizması, API timeout vb.) adım adım analiz et. Mantığı kurduktan sonra contextlib.contextmanager kullanarak temiz bir çözüm üret."Gelişmiş Kod Örneği (Mantıksal Akış Sonucu):

from contextlib import contextmanager

@contextmanager

def user_registration_transaction(user_data):

# AI burada önce mantığı kurduğu için rollback senaryosunu unutmaz

try:

print(f"Veritabanı kaydı başlatıldı: {user_data['name']}")

yield

print("CRM API senkronizasyonu tamamlandı.")

except Exception as e:

print(f"Hata oluştu, tüm işlemler geri alınıyor: {e}")

# Rollback logic

raise5. Bağlam Temizliği (Context Hygiene)

AI’a çok fazla alakasız bilgi vermek, "dikkat" (attention) mekanizmasının dağılmasına ve hatalı sonuçlara neden olur.

Neden Hayat Kurtarır?

AI'ın bir "hafızası" (context window) sınırlıdır. Bu pencere ne kadar gereksiz kodla, eski yorumlarla veya alakasız importlarla dolarsa, AI asıl çözmesi gereken problemi o kadar hızlı "unutur". Bağlamı temiz tutarak AI'ın tüm gücünü sadece o andaki Teknik Borç temizliğine odaklanmasını sağlarsınız.

Kurumsal Uygulama Senaryosu (Refactoring)

1000 satırlık devasa bir core_logic.py dosyanız olduğunu ve sadece içindeki bir hesaplama fonksiyonunu optimize etmek istediğinizi hayal edin.

❌ Yanlış Yaklaşım:

Tüm core_logic.py dosyasını AI'a yükleyip "Bunu düzelt" demek.✅ Doğru Yaklaşım:

"Sadece projenin bağımlılıklarını içerenrequirements.txtözetini vecore_logic.pyiçindekicalculate_interest_ratefonksiyonunu paylaşıyorum. Diğer fonksiyonlarla bir işimiz yok. Bu fonksiyonu Performans Optimizasyonu açısından yeniden yaz."

Sonuç:

AI, alakasız binlerce satır arasında kaybolmak yerine, sadece o fonksiyona odaklanır ve saniyeler içinde çok daha temiz, okunabilir ve optimize bir çıktı üretir.

6. Kesin Negatif Sınırlar (Explicit Constraints)

AI'a kısıtlamalar koymak, çözüm dünyasını daraltır ve projenizin teknik standartlarıyla %100 uyumlu sonuçlar doğurur.

Neden Hayat Kurtarır?

AI genellikle en popüler veya en kolay kütüphaneyi önerir. Ancak kurumsal bir projede, güvenlik politikaları veya Bağımlılık Yönetimi kısıtları nedeniyle belirli kütüphanelerin kullanımı yasaklanmış olabilir. AI'a ne yapmayacağını söylemek, yanlış yönelimleri en başta keserek Kütüphane Uyumluluğu sorunlarını önler.

Kurumsal Uygulama Senaryosu (Hafif Mimari Kısıtları)

Diyelim ki bir AWS Lambda fonksiyonu yazıyorsunuz ve paketin boyutunu küçük tutmak için harici bir kütüphane (örn: numpy veya scipy) kullanmanız yasak.

✅ Doğru Yaklaşım (Kısıtlamalı):

"Bana bir standart sapma hesaplama algoritması yaz. Kesinliklenumpyveya benzeri harici bir kütüphane kullanma. Sadece Python 3.12 built-inmathvestatisticsmodüllerine sadık kal. Ayrıca, bellek verimliliği içingeneratoryapısı kullan."

Sonuç:

AI, kolaya kaçıp import numpy yazmak yerine, projenizin sınırlarına sadık kalarak hafif (lightweight) ve Sürdürülebilirlik ilkelerine uygun bir kod üretir.

7. Halüsinasyon Denetimi (Grounding)

AI bazen var olmayan kütüphaneler veya metodlar üretebilir (Halüsinasyon). Bunu önlemek için AI'ı dökümantasyona sadık kalmaya zorlamalısınız.

Neden Hayat Kurtarır?

Yazılım kütüphaneleri hızla güncellenir. AI'ın eğitim verisi eski kalmış olabilir ve artık desteklenmeyen bir parametreyi (deprecated) kodunuza ekleyebilir. Bu durum, canlıya alım sürecinde kritik hatalara yol açar. Grounding (Temellendirme) teknikleriyle AI'dan "kesin bilgi" istersiniz.

Kurumsal Uygulama Senaryosu (API Versiyon Takibi)

Diyelim ki FastAPI'nin son versiyonunda bir middleware yazdıracaksınız.

✅ Doğru Yaklaşım (Doğrulama İsteği):

"Bu middleware'iFastAPIson versiyon standartlarına göre yaz. Kullandığınmiddleware("http")metodunun mevcut versiyonda hâllâ geçerli olduğunu ve parametrelerin dökümantasyonla uyuştuğunu doğrula. Eğer bir şüphen varsa, en güvenli (fallback) yöntemle ilerle."

İpucu: AI'dan referans vermesini isteyerek "hangi döküman sayfasını örnek aldığını" sormanız, Version Tracking sürecinde sizi saatlerce süren debug işlemlerinden kurtarır.

İleri Seviye AI Orkestrasyonu ve Karar Mekanizmaları

Buraya kadar olan bölümde, AI ile olan bireysel etkileşimlerinizde uygulayabileceğiniz temel mantıksal katmanları inceledik. Ancak profesyonel bir yazılım projesinde verimliliği sadece doğru prompt yazmak değil, bu araçların proje mimarisi ve otomasyon süreçlerine nasıl entegre edileceğini bilmek belirler. İleri seviye bir orkestrasyon, AI'ı bir asistanın ötesine taşıyıp projenin temel karar mekanizmalarından biri haline getirir.

Farklı Senaryolarda AI Stratejileri

8. Yapılandırılmış Çıktı İsteme (Structured Output)

AI'dan gelen ham metni manuel olarak temizlemek yerine, doğrudan yazılım sistemlerinizde işlenebilecek (parse edilebilen) formatlar isteyerek Otomasyon süreçlerinizi hızlandırın.

Neden Hayat Kurtarır?

Erken AI'ı bir CI/CD pipeline'ına veya bir veri işleme akışına entegre ediyorsanız, gelen cevabın "sohbet" içermemesi gerekir. AI'ı belirli bir JSON şemasına veya XML yapısına zorlamak, manuel kopyala-yapıştır yükünü ortadan kaldırır ve hata payını sıfıra indirir.

Kurumsal Uygulama Senaryosu (Veri Madenciliği)

Faturadaki verileri çekip bir muhasebe yazılımına aktarmanız gerektiğini hayal edin.

✅ Doğru Yaklaşım (JSON Modu):

"Extract the invoice number, date, and total amount from the text below. Give the answer only in this JSON format, add no other explanation: {"invoice_no": str, "date": str, "total": float}. Be strictly careful about data type compatibility (float)."Sonuç:

AI size temiz bir JSON objesi verir. Bu çıktıyı Python tarafında json.loads(response) diyerek doğrudan veritabanına kaydedebilir veya bir sonraki Kurumsal Otomasyon adımına aktarabilirsiniz.

9. Özyinelemeli Optimizasyon (Recursive Polishing)

AI'ın ürettiği ilk çıktı genellikle "çalışan" ancak "en iyi olmayan" çıktıdır. İkinci bir gözle kontrol ettirerek Kod Kalitesi standartlarını yükseltin.

Neden Hayat Kurtarır?

Yazılımda bir sorunu çözmenin binlerce yolu vardır. AI ilk seferde en yaygın (ve genellikle suboptimal) yolu seçebilir. Ona "Bunu bir Performans Optimizasyonu uzmanı olarak tekrar incele" dediğinizde, kodun zaman karmaşıklığını (Big O) düşürecek veya bellek tüketimini optimize edecek önerilerle gelir.

Kurumsal Uygulama Senaryosu (Algorithm Improvement)

Suppose you had the AI write a function that finds unique elements in a large list, and the AI used nested loops.

✅ Step 1: "Write a Python function that performs this operation."

✅ Step 2 (Optimization): "Bunu bir Yüksek Performanslı Sistemler uzmanı olarak incele. O(n^2) olan karmaşıklığı O(n) seviyesine indirebilir miyiz? set veya dict yapılarını kullanarak daha verimli bir versiyon üret."

Sonuç:

AI önce çalışan yapıyı kurar, ardından profesyonel standartlara uygun optimize edilmiş versiyonu teslim eder.

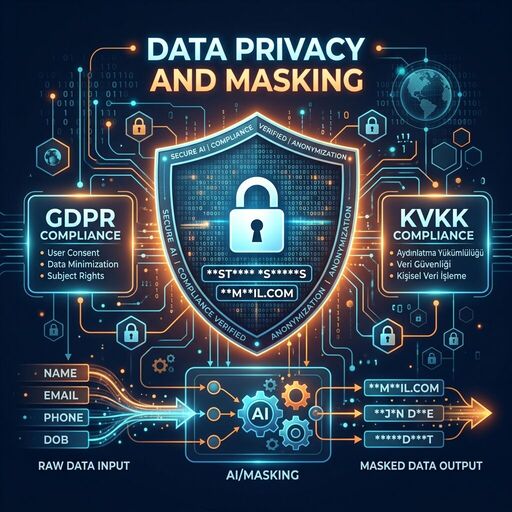

10. Veri Gizliliği ve Güvenliği

Kurumsal dünyada Siber Güvenlik, AI kullanımının önündeki en büyük engeldir. Verilerinizi dışarı sızdırmadan AI gücünden faydalanmayı öğrenin.

Neden Hayat Kurtarır?

Açık kaynaklı veya ticari AI modellerine gönderdiğiniz her veri, potansiyel olarak modelin eğitim havuzuna girebilir. Müşteri bilgilerini, API anahtarlarını veya ticari sırları olduğu gibi paylaşmak, telafisi imkansız hukuki ve teknik riskler doğurur. KVKK ve GDPR uyumluluğu için veri maskeleme hayati önem taşır.

Kurumsal Uygulama Senaryosu (Data Anonymization)

Müşteri şikayetlerini analiz ettireceksiniz ancak veritabanında isim ve telefon numaraları var.

✅ Doğru Yaklaşım (Maskeleme):

AI'a ham veriyi göndermeden önce bir Python scripti ile temizleyin.

import re

def mask_sensitive_data(text):

# İsimleri ve telefonları maskeleme (Basit örnek)

text = re.sub(r'[A-Z][a-z]+ [A-Z][a-z]+', '[AD_SOYAD]', text)

text = re.sub(r'd{10,11}', '[TELEFON]', text)

return text

# AI'a sadece maskelenmiş metni gönderin.İpuçları:

- Her zaman gerçek API anahtarları yerine

YOUR_API_KEYgibi yer tutucular kullanın. - Hassas işler için yerel sunucularda çalışan (Llama 3 vb.) Privacy-First modelleri tercih edin.

11. Kendi Prompt'unu Sorgulama (Meta-Prompting)

Daha iyi sonuç almak için AI'ı kendi Prompt Mühendisliği uzmanınız haline getirin.

Neden Hayat Kurtarır?

Bazen karmaşık bir iş mantığını AI'a nasıl anlatacağınızı bilemezsiniz. AI'a direkt görevi vermek yerine, "Sana bu görevi nasıl en iyi şekilde anlatabilirim?" diye sormak, aldığınız sonucun kalitesini katlar. Bu yöntem, özellikle MVP aşamasındaki projelerde hızlı prototipleme imkanı sağlar.

Kurumsal Uygulama Senaryosu (Prompt Optimization)

Karmaşık bir mikroservis mimarisi tasarlatmak istiyorsunuz.

✅ Doğru Yaklaşım (Meta-Sorgu):

"Sana bir Python mimarisi tasarlatmak istiyorum. En iyi sonuç almak için benden hangi bilgileri talep etmelisin? Lütfen bana profesyonel bir System Prompt şablonu hazırla ve eksik olan teknik detayları (veritabanı tercihi, yük dengesi vb.) liste halinde sor."

Sonuç:

AI size sadece bir cevap vermez; size en doğru cevabı verdirecek olan "soru setini" sunar. Bu, projenin en başında yanlış anlaşılmaları bitirir.

12. Kesinlik ve Yaratıcılık Dengesi (Temperature Awareness)

Teknik analizlerde AI'ın "hayal gücünü" kısıtlamak, yaratıcı işlerde ise serbest bırakmak verimliliğin anahtarıdır.

Neden Hayat Kurtarır?

AI modellerinde "Temperature" (Sıcaklık) parametresi, sonucun ne kadar tahmin edilebilir olacağını belirler. Matematiksel hesaplamalarda veya Determinizm gerektiren kod bloklarında AI'ın yaratıcı olması demek, hata yapması demektir. Öte yandan, bir dokümantasyon yazarken AI'ın daha akıcı ve yaratıcı olmasını istersiniz.

Kurumsal Uygulama Senaryosu (Precision vs. Writing)

- Case A (Kesinlik): "Aşağıdaki finansal verileri kullanarak vergi oranlarını hesaplayan Python fonksiyonunu yaz. Hiçbir yorum ekleme, sadece teknik dökümanlara sadık kal." (Düşük Temperature etkisi).

- Case B (Yaratıcılık): "Yazdığımız bu yeni API için geliştiricilerin ilgisini çekecek, esprili ve akıcı bir README dosyası hazırla." (Yüksek Temperature etkisi).

13. Araçları Etkin Kullanma (System Actions)

AI'nın sadece bir "chat botu" olmadığını; terminal, browser ve dosya sistemiyle etkileşime girebilen bir Teknoloji Ortağı olduğunu unutmayın.

Neden Hayat Kurtarır?

AI'nın 2-3 yıllık eğitim verisiyle sınırlı kalması yerine, o anki güncel dökümantasyona ulaşmasını sağlamak Agentic Workflow başarısının sırrıdır. Bir hata aldığınızda AI'dan internette arama yapmasını veya terminal üzerinden pytest çalıştırıp sonuçları analiz etmesini isteyebilirsiniz.

Kurumsal Uygulama Senaryosu (Troubleshooting)

✅ Doğru Yaklaşım (Araç Kullanımlı):

"Koddaki bu garip hatayı çözemedim. Lütfen tarayıcı aracını (browser) kullanarak bu hata mesajını en güncel Python forumlarında arat ve çözüm önerilerini projedeki tests.py dosyasını çalıştırarak doğrula."14. Agentic Context (Skills & General Instructions)

Modern IDE'ler (Cursor, Windsurf vb.) artık projenin genelini kapsayan talimat setlerini destekliyor.

Neden Hayat Kurtarır?

Her işe başladığınızda "Python kullan, PEP 8'e uy, loglama ekle" demek hem vakit kaybıdır hem de her mesajda bu satırları göndererek Token Maliyeti ve bağlam kalabalığı yaratır. Bunun yerine, bu kuralları .cursorrules veya .project-rules gibi dosyalara bir kez tanımlarsınız. AI her göreve bu temel prensiplerle başlar.

Token Verimliliği İpucu:

"Skills" dosyalarınızı modüler tutun. Gereksiz binlerce satır talimat, AI'ın dikkatini dağıtabilir. Sadece o projenin kritik standartlarını (örn: "Tüm API'lar JWT ile korunmalı") ekleyin.

Örnek Yapı (.project-rules):

# Proje Standartları

- Mimari: Microservices (FastAPI)

- Güvenlik: Auth0 entegrasyonu zorunludur.

- Veritabanı: Sadece SQLAlchemy ORM kullanılacak.Sorun AI'da mı Yoksa Girdi Kalitesinde mi?

AI ile çalışırken yaşanan başarısızlıklar genellikle modele (model capabilities) yüklenir. "AI halüsinasyon görüyor", "AI kod yazamıyor" veya "AI çok yüzeysel kalıyor" gibi şikayetler, aslında bir Mühendislik Psikolojisi ve girdi kalitesi problemidir. Geçmişteki büyük yazılım hataları incelendiğinde, sorunun genellikle teknik kapasiteden ziyade mimari disiplin eksikliği olduğu görülür. AI'ı sadece bir araç olarak görüp, ona gerekli bağlamı sunmadığınızda aldığınız sonuç bir Teknik Borç kaynağına dönüşebilir.

Sorun modelin yetersizliği değil, projenin teknik derinliğinin ve mimari kısıtlarının AI'a doğru aktarılamamasıdır. AI bir zihin okuyucu değildir; o sadece kendisine verilen Semantik Mimari üzerinden en mantıklı olasılığı üretir. Eğer çıktı kötüyse, genellikle "input hijyeni" bozulmuştur.

Profesyonel Bir Kaldıraç Olarak AI

Sonuç olarak AI, yazılım geliştirme sürecini sihirli bir şekilde kolaylaştıran bir araç değildir; o, profesyonel bir yazılımcının elinde etkisini 10 kat artıran bir Kaldıraç aracıdır. Bu 14 ipucunu bir "prompt listesi" olarak değil, bir çalışma disiplini olarak benimsemek, projenizin ölçeklenebilirlik ve sürdürülebilirlik hedeflerine ulaşmasını sağlar.

Bu noktada olan birçok ekip, karmaşık sistemlerde AI orkestrasyonunu tek başına yönetmeye çalışırken vakit kaybedebiliyor. Ancak doğru mimari kurgu ve disiplinle, AI sadece bir asistan olmaktan çıkıp projenizin en stratejik parçası haline gelebilir.

Sıkça Sorulan Sorular (FAQ)

AI ile çalışırken token maliyetlerini nasıl düşürebiliriz?

Token maliyetini düşürmenin en etkili yolu Modüler Context yönetimidir. Her prompt'ta tüm projeyi göndermek yerine, sadece ilgili fonksiyonları ve "General Instructions" dosyalarını (Tip 14) kullanmak maliyetleri %60-70 oranında azaltır. Ayrıca, kesinlik gerektirmeyen işlerde (dokümantasyon vb.) daha ucuz modelleri (GPT-4o Mini, Claude Haiku) tercih etmek stratejik bir kazanımdır.

Prompt Engineering zaman kaybı mı?

Tam tersine; en başta 5 dakika ayırıp doğru bir Persona ve Constraints seti belirlemek, hatalı çıktıların düzeltilmesi için harcanacak saatleri önler. Bu bir yazılım tasarım sürecidir.

Her iş için en büyük AI modelini mi kullanmalı mıyız?

Aslında hayır. Büyük modeller (örn: GPT-5) karmaşık mimari kararlar ve Semantik Mimari kurguları için idealdir. Ancak unit test yazımı veya dokümantasyon gibi daha rutin işlerde küçük/hızlı modeller (örn: GPT-5 Mini, Claude Haiku) hem daha hızlıdır hem de Token Maliyeti açısından çok daha verimlidir. Proje genelinde bir "Model Selection" stratejisi izlemek, bütçe yönetimini optimize eder.